1956年に米国で開始された人工知能(AI)は、ソーシャルネットワークからGPSナビゲーション、顔認識から医療診断や産業ロボット工学まで、私たちの日常生活に完全に投資しています…それは研究者、市民、または州の注意を魅了し、怖がらせ、独占しています。私たちが話していることを理解するには、基本に戻り、AIとは何か、その歴史、どのように機能し、何をもたらすことができるのか、そして何が危険なのかを説明しなければなりません。パリ・サクレー大学のコンピュータサイエンスの教授であり、デジタル科学学際研究所(LISN-Univ)の研究者であるNicolas Sabouretは、RFIの質問に答えます。

1.RFI: 人工知能とは何ですか?

ニコラ・サボレ:理解するためには、「人工知能」という用語の起源に戻らなければなりません。

1950年代、英国の研究者アラン・チューリングは計算、特に計算可能性と複雑さの理論に取り組みました。コンピュータとコンピュータは情報処理の科学であり、情報変換は計算であることを覚えておく必要があります。規律の先鋒であるチューリングは、何が計算可能で、何が複雑かを定義しました。先見の明のある彼は、このような計算を行う機械が、いつかチェスをしたり、車を運転したり、人間が知性で行うタスクを実行したりできるようになると想像しました。彼は当時、「機械がこれを行うことができれば、「マシンインテリジェンス」について話すことができます。これはその後、「人工知能」、すなわち人工知能を与えたものです。

チューリングの先見の明のある側面を超えて、理解すべき2つの重要なポイントがあります。1つ目は、研究者が機械が知的であると言うことはありません。機械は計算し、考えない。彼女は私たちよりも物事をうまくやっています、または少なくともいくつかの分野で私たちと同じくらいうまくやっています。しかし、彼女は知性ではなく、計算でそれをします。オランダの研究者エドガー・ダイクストラは、この素晴らしい文章を言った:「コンピュータが考えることができるかどうかを尋ねることは、潜水艦が泳ぐことができるかどうかを尋ねるのと同じくらい愚かです。この引用はすべてを要約しています。「人工知能」という用語をこのように理解すると、私たちはインテリジェントマシンについて話していないことを理解します。私たちは、計算を使って人間の能力を模倣し、再現することについて話しています。

2番目のポイントは、計算の複雑さの概念です。チューリングは、いくつかの問題が機械によって複雑または実行不可能であることを理解していました。その後、彼は計算によってそれらを解決する方法を疑問に思いました。説明するために、例えば、チェスのゲームを考えてみましょう。1930年代、アメリカの数学者ジョン・フォン・ノイマンは、毎回勝つためにチェスの完璧なゲームを計算することを可能にするアルゴリズムを提案しました。しかし、これを達成するためには、10パワー120のオーダーである多くの操作を行う必要がありますが、これは不可能です。したがって、AI研究者は、正確な解決策を得ることができないことを知って、合理的な計算時間で解決策を探します。私たちは、ほとんどの場合、正しい結果を得るために緊密な解決策を作ることに同意します。人工知能では、ヒューリスティックについて話します。

人工知能という用語は非常に誤解を招く。実際、完璧に機能させることができないことがわかっていても、ほとんどの場合機能するように問題を簡素化したのはコンピュータ計算です。

2.AIはいつ生まれ、時間の経過とともにどのように進化しましたか?

人工知能は、1950年にアラン・チューリングの「コンピュータ機械と知能」と題した記事の出版で始まり、その中で彼は「機械が考えることができる」かどうか疑問に思い、彼の有名なチューリングテスト、模倣のゲームを提起しました。

「人工知能」という用語が最初に使用されたのは、研究者が米国のダートマス大学で出会った1956年でした。会議の主催者であるアメリカの数学者ジョン・マッカーシーは、チューリングの用語である「機械知能」という用語を保持しないことを決定し、「人工知能」の用語を選択しました。1950年代の終わりから、テレビ、ラジオ、新聞記事などのクリップを通じて「すべてを行うことができ、それが私たちの生活を変える」機械にクレイジーな発泡がありました。

AIは1970年代初頭まで非常に人気がありました。しかし、結果はそこになく、熱意は低下し、AIは1980年代初頭まで最初の「冬」を経験しました。その後、人間の知性を模倣しようとする手書きのルールに基づく専門家のシステムでリバウンドがありました。それは5年間続き、息が下がった。これは1985年から2005年まで続くAIの2回目の冬です。

確かに、1990年にIBMがディープブルーでAIへの打撃を回復しようとする試みがありました。しかし、カスパロフがすべての可能な動きを事前に計算できる機械の前に従うことができないことを人々が見たので、それはうまくいかなかった。その機械は本当に賢いですか?それはAIにはあまり役に立たなかった。

2005年、AIを再び離陸させた2つの非常に信じられないことが起こりました。

1つ目は、ビデオゲーム業界によるグラフィックカードの開発です。グラフィックカードは、同時に非常に迅速に非常に多くの加算と乗算を行う能力を持っています。

1990年代、研究者のヤン・ル・クンとジョシュア・ベンジオは、うまく機能しているように見えるニューラルネットワークを提案しましたが、当時は持っていなかった計算手段が必要でした。2005年、彼らは「ディープラーニング」と題した記事を発表し、グラフィックスカードを使用すると、複数のレイヤーのニューロンを同時に計算し、2つのレイヤー以前よりも優れたパフォーマンスを発揮できると説明しました。それは機能し、ニューラルネットワーク技術は研究者を説得し始めた。

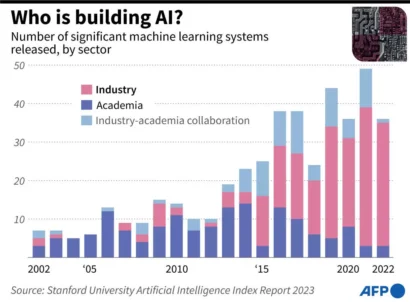

2つ目は、ゲームの未解決の問題に取り組むための検索ユニットのGoogleによる作成です。彼らは、アルゴリズムのパフォーマンスを向上させるために、ニューラルネットワークを接続するために使用される古典的なアルゴリズムを使用します。囲盤ゲームは、マシンを自分自身と対戦させることができ、トレーニングできるため、面白いです。彼女は自分自身に対してうまくプレイすることを学ぶまで、自分自身に対して何百万ものゲームをプレイすることで、ニューラルネットワークのパラメータを全速力で自動的に調整します。古典的な計算技術とニューラルネットワークのこの混合物は、2015年に、現ゴー世界チャンピオンに対するAlphaGoの勝利につながった。このイベントはAIのテーマ全体を復活させ、人々はこの分野に再び投資しています。

2015年以来、AIの冬は後退しておらず、ジャーナリストが一般大衆に放送するAIの限界に関する研究者の慎重なコミュニケーションのおかげであると思います。「注意してください、AIは毎回機能するわけではありません、それはすべてを行うことはできません、そして私たちはそれに取り組んでいます」、1960年代と1980年代とは異なり、10年後には

その後、さまざまなニューラルネットワーク技術が開発され、特に今日話しているもの:「生成トランスフォーマー」アルゴリズム、ChatGPTやDall-Eなどの生成ネットワークを作成するために使用される生成トランス。

3.私たちが日常生活で見つけるAIの応用分野は何ですか?

AIはどこにでも隠されています。郵便で手紙を送るとき、選別機はAIアルゴリズムを使用して郵便番号を読み取ります。これは早くも1990年代です。別の例:なぜエレベーターは正しい階でゆっくりと止まるのですか?エレクトロニクスに組み込まれたAIアルゴリズムのおかげで。

毎日使用されているAIアルゴリズムがあります。1つ目は、Googleのような検索エンジンを介した情報の検索です。それから、GPSナビゲーション補助があります。そしてソーシャルネットワーク:多くの人々はそれを全く認識していませんが、彼らに投稿を提供するアルゴリズムはAIです。リアーナの投稿が気に入ったら、ジャスティン・ビーバーの投稿が気に入るでしょう。たとえば、新しい靴を検索する場合、Instagramアカウントで靴の広告を提供するAIアルゴリズムです。

4.AIを使用する他の分野は何ですか?

医学では、医療診断に役立つツールが20年間開発されており、かなりうまく機能しています。しかし、それらを実践することの難しさは、すべての情報を機械に入力するために必要な時間によるものです。一般開業医は、彼を聴診することによって患者を診断することができる間、本当にすべての情報を入力するのに30分を費やしたくありません。

一方、自動画像認識アルゴリズムは、人間と機械の間の真の補完的な使用を可能にします。マシンは、ファイル全体を持っている医師が確認できるかどうか、画像に対して一種の事前診断を行います。

これらのことが整い始めており、数年後には、医療の文脈でAIを使用してスマートなことをすることに本当に成功すると思います。

AIは意思決定ツールにも使われています。配水会社は、実際に実装する前に、AIを使用して配水ネットワークに関する仮説をテストします。または、EDFはAIアルゴリズムを使用して負荷曲線を生成し、家計消費がどのように進化するかを研究することを可能にします。これらのAIアルゴリズムは、人間が行うことを再現します。これは、AIの人間のシミュレーション部分が役立つ場所です。

一般には見えないAIのもう一つの大きな進歩は、広く使用されていますが、健全な処理に関するものです。今日、すべてのサウンド処理システムにAIアルゴリズムがあり、ラジオやDVDなどで非常に高品質のサウンドを持つことができます。

AIはまた、大量の天文データを保存、保存、検索、整理できるようにすることで、無形遺産(テキスト、画像、オーディオ)の保存に関連するすべてのものに革命をもたらします。

AIは、生産ラインを最適化するために航空や産業界でも使用されています。

5.AIはどのように機能しますか?

最初のAI技術は、1970年代と1980年代に非常に人気があったルールライティングに基づいています。例えば、パリからマルセイユまで車で行く方法を尋ねると、あなたが従うステップを教えてください。「道路標識を見たら、右に曲がります。クマを横切ったら、当たらないようにブレーキをかける」など、プログラミングで人間の推論を再現するために、手でルールを書きます。

これらのルールが書かれたら、それらを実装する計算技術があり、非常に信じられないほどの結果を得ることができます。ロボットが火星に送られるとき、彼らはルールベースのシステムで働きます。それはかなり適応性があり、私たちは起こることすべてをコントロールします。私たちはエラーをどこに置いたかを知っているので、行われた近似値を知っています。ロボットが間違っているとき、私たちはその理由を知っています。このタイプのタスクを実行するために提案されている自動診断と計画技術があり、それは非常にうまく機能します。

2番目のAI技術は、フランス語で「機械学習」を意味する機械学習です。アイデアは、物事のやり方を機械に伝えることです。研究すべき重要な変数を決定し、これらの変数間のリンクを自動的に計算するよう機械に依頼します。彼は、欠損値があるプログラム構造が提供され、それが機能するための値を見つけるように求められます。

私が与えたいイメージは、オーディオミキサーのイメージです。入り口でどんな音がしても、出口で同じ音を得るためにボタンの正しい位置を見つける必要があります。無限の可能性に直面して、マシンは、それが徐々にそれが可能な限り最高の出力を計算することを可能にするパラメータを調整できるように、それに多数の例を与えることによって訓練されます。すべてのボタンを少し動かすことで、ほとんどの場合、非常にうまく機能する値を見つけることになります。さらに、機械学習という用語はかなり選択が不十分です。現場の研究者はむしろ訓練について話します。

今日最も広く使用されている機械学習技術は、人間のニューラルネットワークとは何の関係もないニューラルネットワークの技術です。フランク・ローゼンブラットが1957年に彼のマシンを作曲したときにそれに触発された場合、彼は人工ニューロンを作ったと主張したことはありません。

人工ニューラルネットワークは、連鎖された加算と乗算の連続です。過去には、それを計算する機械がなかったため、一層ニューラルネットワークの作り方しか知りませんでした。今日、ディープネットワークは約10層で構成されており、あなたや私のようなコンピュータはこのタイプのニューラルネットワークを問題なく実行できます。3つの層から、私たちは「ディープラーニング」について話します。

ニューラルネットワークはさまざまな方法で使用できます。トランスフォーマーを使用すると、ニューラルネットワークをトレーニングして、あらゆる概念を数値に変換し、別のニューラルネットワークのおかげで、テキスト、音声、または画像を生成する結果を生成します。画像を生成するAIに「教皇に白いダウンジャケットが欲しい」と尋ねると、彼女は数字の「教皇」と「白いダウンジャケット」という数字を組み合わせて、白いダウンジャケットを着た教皇の画像を作ります。

ChatGPTもそのように機能します。彼はフランス語のすべてのテキストを与えられ、そこから人間が書くことができたものと非常によく似たテキストを生成することができました。一方、質問がばかげている場合、例えば「ウサギの卵について教えてください」、彼はウサギの卵について話します。彼はナンセンスを言うだろうが、彼はそれをとてもうまくやるだろう。ChatGPTの背後には小さな秘密があることを知っておくべきです:それは多くの文章と人間を生成するために作られました – 私たちは何千時間も何千人もの人間について話します – 尋ねられた質問に関連して可能な限り最も信頼できる答えにするために手で各文を修正しました。ChatGPTが人間のように話す印象を与えるために非常に強くなった、彼が人種差別的な発言をしない、または彼が「私は知らない」と言う方法を知っているのは、これらのむしろ恩知らずな「微調整」のタスクのおかげです。

最後に、これら2つの技術の違いは、プログラミング時間の限界であり、したがって開発における人的コストです。実際には、これらの学習アルゴリズムは、コンピュータ科学者が手でコーディングすることで同時に行うよりもはるかに良い結果をもたらすことがよくあります。パラメータを調整する作業は退屈で、機械はそれを非常にうまくやっています。だからこそ、機械学習はうまく機能します。

6.弱いAIと強いAIの違いは何ですか?

私たちの日常使用に存在し、マスコミで話題になっているAIは、強力なAIのこの種の夢とは対照的に、すべて弱いAIです。また、強力なAIがすぐに到着すると想像する研究者はほとんどいません。

強力なAIは、言語と人間の知性の問題を専門とする哲学者ジョン・サールによって提案された概念です。彼は、人工知能がお互いに全く異なる問題に対処することができれば、つまり車を運転したり、チェスをしたり、サンドイッチを作ったり、多くの異なることができるAIであれば、人間の知能に近いという点で「強い」と言えると言いました。

したがって、私たちはむしろ、ますます複雑な問題を解決するために、さまざまな弱いAI技術を改善することで構成されるアプローチに取り組んでいます。各AIアルゴリズムは、非常に特定の問題のファミリーを解決し、他のコンテキストでは必ずしも再利用可能ではありません。例えば、チェスをとても上手にプレイするAIは、囲碁のゲームをプレイさせたい場合は、それを再訓練する必要があります。彼に車を運転するように頼むことはできない。そのためには、別のAIを使用する必要があります。

7.いわゆるジェネレーティブAIの開発で何が変わりますか?

私はジェネレーティブAIについて表現される恐怖に非常に懐疑的です。明らかに、教師として、生徒がより簡単にカンニングするのを見ることを心配することができます。ウィキペディアが出てきたとき、私たちは同じものを見ました。しかし、生徒は何も理解していなかったので、ページがコピーされたとき、教師はかなり早く話していました。追加レベルは、ChatGPTがウィキペディアのページを合成し、それをかなりうまく行うということです。私たちは、学生がさらに不正行為をするのを見ることを心配することができます。しかし、私はそうは思いません。それどころか、人々はChatGPTの使い方を教える必要があると思います。機械がすでによく準備された要素を生成し、やり直すことができるという考えは、ウィキペディアに行って情報を検索し、それを修正するときのようなものです。

画像の側面では、画像操作の専門家でない限り、生成システムによって生成された画像をやり直すことができないので、私はより控えめです。だから、私たちは彼らをそのまま受け止めます、そして問題は、彼らが完全に間違っているとき、彼らは真実に見えるということです、彼らは現実を記述しません。テキストと同じくらい、人々はそれを少し慎重に受け止めます。しかし、私たちは、画像がメディアで見られる場合、それは真実であると考えることに慣れてきました。したがって、画像は機械の産物である可能性があることを認めなければなりません。これは私が恐怖を表現する人々と合流する場所です。

生成AIアルゴリズムはまた、研究者が因果関係の概念などの他のAI問題を攻撃することを可能にします。これはキャプチャが非常に複雑で、現在は手で書くことを余儀なくされています。研究者としての私の視点から見ると、それは本当に私たちが進歩することを可能にする進歩です。一般市民の観点から、私はかなり懸念を聞いています。

例えば、スーパーマーケットのレジ係を自動レジに置き換えると、バーコードを読んだり、スケールに置いた果物を認識したりするためのAIが確かにあります。しかし、レジ係の仕事の喪失は技術の問題ではなく、社会の選択の問題です。そして、これらのツールの展開の犠牲者になる人々を確実に保護しなければなりません。社会として、私たちは今、そこでそれを行うことを学ばなければなりません。物事は常に進化しているため、ジェネレーティブまたは他のAIシステムによって変更される職業があります。私たちが知性で行う特定のタスクを私たちよりも優れたパフォーマンスを発揮する機械を作ることができれば、これらのタスクを行うことで生計を立てている人々にどのように同行することができますか?私たちの社会はこれに対処し、失業や強制的な再訓練を避けることができると思います。そして、私たちのスキルに取り組むことができるようにAIを使用するように人々に教える。

ジャーナリズムは、ジャーナリストが個人と情報の間のリンクであるため、これらのAI問題に関連して、今日最も進化している職業の1つです。もともと情報処理機械だった機械は、情報生成機械になりました。したがって、情報の生成者であるジャーナリストも、機械が決してできないことが真実であることを証明するために、情報の規制当局または管理者になる必要があるかもしれません。ジャーナリストは、彼の仕事を通じて、この記事で言われていることや画像に表示されていることが特定の現実に対応していることを証明することができます。しかし、確かに、偽情報の世界には明るい未来があります。

8.AIはどのように潜在的に危険である可能性がありますか?

どんな技術も潜在的に危険です。技術を作成するとき、あなたはそれが誤用される可能性があることを知っています。それ自体が危険なのはAIではなく、あなたがコントロールできないモンスターを作ったという神話から抜け出さなければなりません。私たちは、機械が何をし、どのようにそれを行うかを知っています。彼らが行った計算を説明する方法がわからないかもしれませんが、結果を管理します。私たちは、彼らが間違いを犯す可能性があることを知っており、それが起こると、その理由を理解し、それを改善しようとします。

それは技術的な問題ではなく、社会的な問題です。研究者が彼らの機械の使用を心配していること、私はそれを理解しており、それは合法です。1940年代初頭、核分裂を共同発見したオーストリアの物理学者リーゼ・マイトナーは、この発見を使って爆弾を作るのは普通ではないため、マンハッタンプロジェクトに参加しないと述べた。研究者が、ジェネレーティブAIから「フェイクニュース」(「インフォックス」)を作るシステムを作ることを心配していると言うことは、完全に合法です。

しかし、実際には、私たちは研究者としての役割に戻り、科学的レベルで意見を述べなければなりません。社会レベルでは、決めるのは私たち次第ではなく、私たちの仕事ではありません。それは、このテーマについて言いたいことがある社会、政治家、ジャーナリスト、芸術家、他の人々です。私たち科学者は、それがどのように使用されるかを見るためではなく、知識を創造するためにそこにいます。

一方、潜在的に危険であるため、そのような分野での研究を中止しなければならないと言うことに反対です。知識が危険だと信じるのは間違いだと思います。危険なのは知識の使用であり、それが違いです。AIに関する研究は続けなければなりません、これらは一時停止すべき用途です。しかし、私たちはこれに関する世界的な合意を見つけることは決してないので、それは複雑です。中国人が路上で人々に注目するために顔認識を使ってから5年が経ちました。アルゴリズムは人しか認識しないことを知っておく必要があります。メモを置くのは人間です。乳がんを検出できるのと同じ人工視覚の研究を停止する必要がありますか?私はそうは思いません。

AIを知っている人は、その用途について警告し、これは正常です。言う:「注意してください、Dall-Eで、あなたは何でも、すべてのイメージを作ることができます。同様に、ChatGPTが非常に真実に見えるテキストを作成できることを示すために出てきたのは良いことです。たとえそれがウサギの卵、存在しないものについて話していても、それはとてもよく話します。「ディープフェイク」で、私たちはジョー・バイデンにロシアを爆撃するように言わせることができる。これらのAI技術で何ができるかを人々が知っているのは良いことです。彼らはその主題を把握し、私たちが話していることを理解しなければなりません。それが危機に瀕していると思います。

Nicolas Sabouretは、パリ・サクレー大学のコンピュータサイエンスの教授であり、デジタル科学の学際的研究所(LISN-Univ)の研究者です。彼はEllipsesによって出版された「人工知能を理解する」の著者であり、人工知能の哲学者Laurent Bibardとの共著者は技術的な問題ではありません。Éditions de l’Aubeの哲学者とコンピュータ科学者の交流。

https://www.rfi.fr/fr/connaissances/20230609-intelligence-artificielle-de-quoi-parle-t-on-vraiment